微信里点“发现”,扫一下

二维码便可将本文分享至朋友圈。

32K上下文,Mistral 7B v0.2 基模型开源了

刚刚,Mistral AI 的模型又更新了。

这次开源一如既往地「突然」,是在一个叫做 Cerebral Valley 的黑客松活动上公布的。

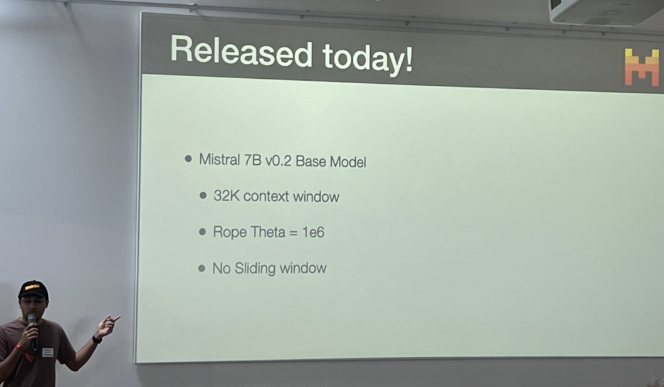

PPT 一翻页,全场都举起了手机拍照:

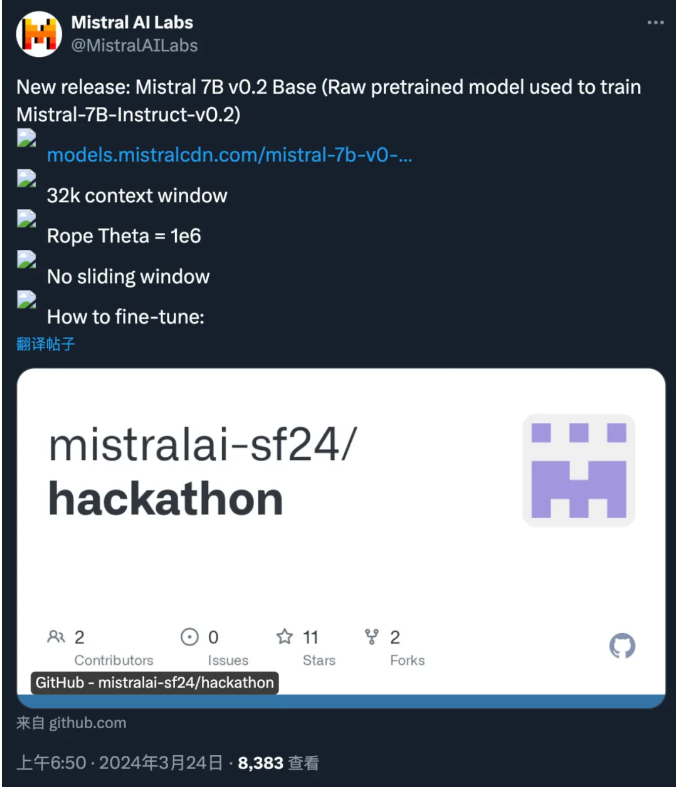

这次开源的 Mistral 7B v0.2 Base Model ,是 Mistral-7B-Instruct-v0.2 背后的原始预训练模型,后者属于该公司的「Mistral Tiny」系列。

此次更新主要包括三个方面:

- 将 8K 上下文提到了 32K;

- Rope Theta = 1e6;

- 取消滑动窗口。

下载链接:https://models.mistralcdn.com/mistral-7b-v0-2/mistral-7B-v0.2.tar

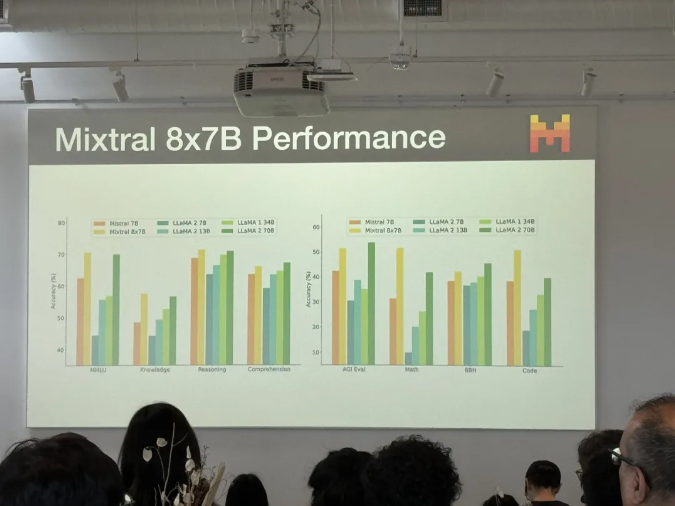

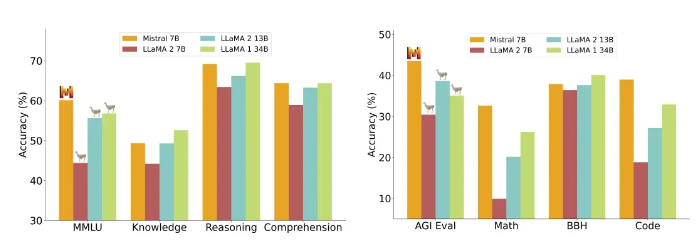

更新之后的性能对比是这样的:

场外观众迅速跟进。有人评价说:「Mistral 7B 已经是同尺寸级别中最好的模型,这次改进是一个巨大的进步。 我将尽快在这个模型上重新训练当前的许多微调。」

Mistral AI 的第一个 7B 模型发布于 2023 年 9 月,在多个基准测试中实现了优于 Llama 2 13B 的好成绩,让 Mistral AI 一下子就打出了知名度。

这也导致目前很多开源大模型都已不再对标 Llama 2,而是将 Mistral AI 旗下的各系列模型作为直接竞争对手。

而 Mistral 7B v0.2 Base Model 对应的指令调优版本 Mistral-7B-Instruct-v0.2 在 2023 年 12 月就已开放测试,据官方博客介绍,该模型仅适用于英语,在 MT-Bench 上能够获得 7.6 分的成绩,逊于 GPT-3.5。

此次开放基础模型之后,开发者们就可以根据自己的需求对这个「当前最好的 7B 模型」进行微调了。

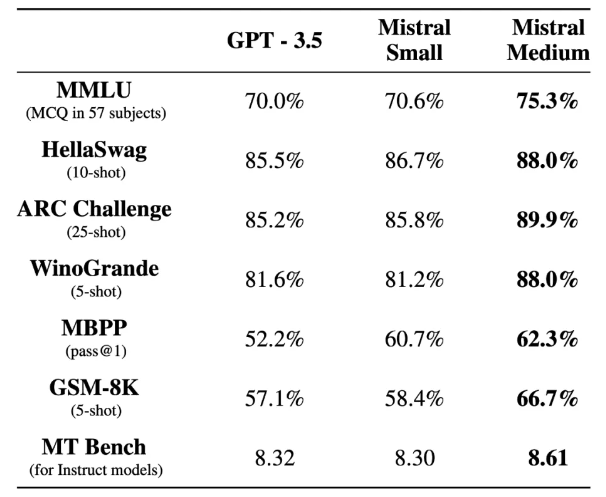

不过,7B 模型只能算是 Mistral AI 众多惊艳成果中的一项。这家公司的长远目标是对标 OpenAI。

上个月底,Mistral AI 正式发布了「旗舰级」大模型 Mistral Large。与此前的一系列模型不同,这一版本性能更强,体量更大,直接对标 OpenAI 的 GPT-4。随着 Mistral Large 上线,Mistral AI 推出了名为 Le Chat 的聊天助手,也实现了对标 ChatGPT。

而新模型的发布,也伴随着公司大方向的一次转型。人们发现, Mistral Large 并不是一个开源大模型 —— 有跑分、 API 和应用,就是不像往常一样有 GitHub 或是下载链接。

与 Mistral Large 发布同时发生的,是 Mistral AI 与微软达成了长期合作的协议,不仅会将 Mistral Large 引入 Azure,还收获了微软 1600 万美元的投资。

Mistral AI 对路透社表示,作为交易的一部分,微软将持有该公司少数股权,但未透露细节。未来,二者的合作主要集中在三个核心领域:

- 超算基础设施:微软将通过 Azure AI 超级计算基础设施支持 Mistral AI ,为 Mistral AI 旗舰模型的 AI 训练和推理工作负载提供一流的性能和规模;

- 市场推广:微软和 Mistral AI 将通过 Azure AI Studio 和 Azure 机器学习模型目录中的模型即服务(MaaS)向客户提供 Mistral AI 的高级模型。除 OpenAI 模型外,模型目录还提供了多种开源和商业模型。

- 人工智能研发:微软和 Mistral AI 将探索为特定客户训练特定目的模型的合作。

当被问及公司是否正在改变其开源商业模式时,Mistral AI 联合创始人 Arthur Mensch 在采访中表示:「我们从开源模式开始,任何人都可以免费部署,因为这是广泛分发它们并创造需求的一种方式。但从一开始,我们就提供了一种具有优化模型的商业模式,这让使该公司能够为模型开发所需的昂贵研究提供资金。」

(本文来源公众号:机器之心,如有侵权请联系删除)

微软与Mistral AI达成合作

零一万物:开源Yi-9B模型

智源FlagEval大模型评测1月榜单发布

上海AI实验室:开源发布书生·浦语数学大模型

腾讯发布视频生成模型VideoCrafter2